Artikelenserie over kunstmatige intelligentie (23 #1)

(23 #1)..|..(23 #2)

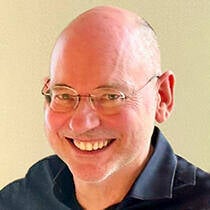

Simon Been

Trainer en klankbord voor AI in het informatiedomein en directeur van het Papieren Tijger Netwerk

Wat is de impact van AI op het informatiedomein? Deze 23ste aflevering van de artikelenreeks richt zich op kennismanagers, intranetredacteuren, functioneel beheerders, privacy- en gegevens-beschermingsfunctionarissen en security officers. Zij bouwen en bewaken het informatiekundig fundament waarop het werk van de organisatie rust, en precies dat fundament staat onder druk. Dit deel #1 gaat over wat er gebeurt en waarom, het vervolg (deel #2) op de pagina hierna over wat jij eraan kunt doen.

Generatieve AI is een krachtig instrument. Dat is niet de discussie. Wie ermee werkt, merkt het: denken gaat sneller, overzicht komt gemakkelijker, communiceren wordt helderder. Geen wonder dat collega’s in de organisatie er gretig gebruik van maken; soms enthousiast, soms stilletjes. De technologie heeft absoluut beperkingen, maar levert doorgaans stevige voordelen.

De problemen beginnen zoals zo vaak niet bij de technologie zelf. Ze beginnen bij de manier waarop organisaties die invoeren. Zonder doordacht beleid. Zonder de juiste expertise aan tafel. Zonder oog voor wat er met de informatiehuishouding gebeurt als – soms duizenden – medewerkers AI-tools gaan gebruiken die niet zijn ingepast in de bestaande kennisstructuren. Als informatieprofessional herken je dit. Gelukkig kun je er ook iets aan doen. En dat is de missie achter deze reeks: verantwoord gebruik mogelijk te maken, op twee niveaus tegelijk.

> Op persoonlijk niveau gaat het om bewustwording: wie begrijpt hoe AI werkt en waar de keerzijden zitten, gebruikt het effectiever én vermijdt de valkuilen. Dat gaat niet om trucjes leren, maar om volwassen inzicht. Dat levert winst op voor de gebruiker zelf, en voor wat hij of zij produceert.

> Op organisatieniveau speelt hetzelfde, maar zijn er meer instrumenten. Persoonlijk verantwoord gebruik stimuleren is er één van. Wat deze artikelen belichten zijn informatiekundige randvoorwaarden en succesfactoren om AI in staat te stellen de belofte waar te maken. Niet als rem, maar als fundament.

Omdat ‘de’ informatieprofessional niet bestaat – de verantwoordelijkheid voor ‘informatie’ binnen organisaties is enorm versnipperd – onderscheiden we vier categorieën:

1. Organisatiegeheugen & Verantwoording

2. Informatieverstrekking & Ondersteuning

3. Kennisorganisatie & Informatiestromen

4. Communicatie & Externe Informatie

In de vorige IP’s is ingegaan op de situatie van de eerste twee categorieën informatieprofessionals en hun mogelijke reacties op de AI-impact. Voor archivarissen en DIV’ers (aflevering 21 deel #1 en deel #2 in deze reeks) verdampen de paper trails. Voor informatiespecialisten (artikel 22) worden gebruikers onzichtbaar zelfstandig. Voor de mensen die de kennisstructuren van de organisatie bouwen en bewaken is het probleem subtieler, en daardoor gevaarlijker.

KLASSIEKE KENNISSTROOM | AI-KENNISSTROOM |

Medewerker zoekt informatie | Medewerker vraagt AI |

Bron wordt expliciet geraadpleegd (intranet, kennisbank, document) | AI haalt informatie uit meerdere bronnen tegelijk |

Redactionele controle vooraf | Geen zicht op bronselectie |

Informatie blijft zichtbaar | Redenering verdwijnt |

Kennis wordt gedeeld via teams, wiki’s of overleg | Kennis blijft vaak |

EEN DIVERSE GROEP

De doelgroep van dit artikel is breder en diverser dan bij de vorige twee afleveringen. Het heeft zin even stil te staan bij wie er precies wordt aangesproken, want achter elke functietitel gaat een eigen wereld schuil. Enige verdieping vind je in het kader op de volgende pagina.

De kennismanager of contentmanager organiseert hoe kennis in de organisatie beschikbaar is en stroomt: als zelfstandige functie of gecombineerd met andere rollen, afhankelijk van de organisatie.

De intranetredacteur beheert interne informatiekanalen: van nieuws tot procedures tot beleidsinfo, als zelfstandige functie of gecombineerd met communicatie of secretariaat.

De functioneel beheerder is de schakel tussen gebruikers en ICT. Hij of zij beheert applicaties vanuit functioneel perspectief: bepalen wat een systeem moet kunnen, niet zozeer hoe het technisch werkt.

De privacy- en gegevensbeschermingsfunctionaris (FG of DPO) is de wettelijk verankerde toezichthouder op de verwerking van persoonsgegevens: onafhankelijk, met directe toegang tot de hoogste leiding.

De data en information security officer – in grotere organisaties de CISO – bewaakt de informatiebeveiliging: strategisch, operationeel of beide. De wettelijke verplichtingen zijn de afgelopen jaren fors uitgebreid.

Informatiehuishoudingspecialisten tenslotte raken aan meerdere van de categorieën in deze reeks. Wie primair bezig is met records, archivering en bewaarplicht, herkent zich meer in artikel 21.

TWEE CLUSTERS, ÉÉN GEDEELD PROBLEEM

Binnen deze groep zijn er twee clusters die elk op een eigen manier worden geraakt door AI. Het eerste cluster zijn de kennismanagers, intranetredacteuren en functioneel beheerders. Zij organiseren hoe kennis en informatie beschikbaar komen in de organisatie. Hun mandaat is functioneel: ze bestaan omdat de organisatie ze nodig heeft, niet omdat een wet ze verplicht. Hun gedeelde zorg is dat AI de structuren omzeilt die zij hebben opgebouwd en bovendien die structuren tegelijk als ‘voer’ gebruikt, zonder hun betrokkenheid.

Het tweede cluster zijn de privacy- en gegevensbeschermingsfunctionarissen en de security officers. Zij bewaken de regels rond informatie. Hun mandaat is wettelijk en groeit. Hun zorg is het omgekeerde: niet dat ze worden gepasseerd, maar dat ze hun wettelijke plicht niet meer kunnen waarmaken. Je kunt geen toezicht houden op wat je niet kunt zien.

Verschillende uitgangsposities, één gedeeld probleem: AI neemt hun grip op informatiestromen weg.

WAAR HET MISGAAT

De frontlinie: wat er dagelijks langs je heen gaat

Een beleidsmedewerker vraagt Copilot om de geldende aanbestedingsregels samen te vatten. Copilot antwoordt soepel en zeker, op basis van documenten in SharePoint. Wat de medewerker niet ziet: Copilot heeft ook een verouderd concept uit 2022 meegewogen, want dat document staat er nog steeds en heeft geen metadata die aangeven dat het niet geldig is. De intranetredacteur die het actuele beleid zorgvuldig heeft gepubliceerd weet van niets. De kennismanager die de kennisbank beheert ook niet. De medewerker vertrouwt het antwoord. Want het is intern en het klinkt compleet.

Dit speelt in elke organisatie waar AI is uitgerold in een documentomgeving die niet op orde is. En – laten we eerlijk zijn – die is zelden volledig op orde.

Tegelijk gebruikt een collega ChatGPT voor hetzelfde vraagstuk, maar dan via zijn privéaccount, met een intern beleidsdocument als context. De security officer heeft geen zicht op die datastroom. De FG/DPO ook niet. In grote organisaties gebruikt een aanzienlijk deel van de medewerkers AI-tools die niet zijn goedgekeurd. Verboden of niet. Volgens recent onderzoek is dat zelfs de helft.

En de functioneel beheerder? Die ontdekt op een maandagmorgen dat de Teams-omgeving die hij beheert een nieuwe AI-functie heeft. Voor samenvattingen bijvoorbeeld. Ingeschakeld door de leverancier, niet door hem. Geen projectplan, geen implementatiebesluit, geen betrokkenheid. Dat is het verschil met een formele systeemimplementatie, waarbij de functioneel beheerder normaal gesproken wel vroeg betrokken wordt. AI wordt niet als project uitgerold, maar als feature toegevoegd. Dat is een fundamenteel ander patroon.

De afdeling

Op afdelingsniveau stapelen de gevolgen zich op. De kennismanager krijgt vragen over AI-gebruik die hij niet goed kan beantwoorden, want hij is bij geen enkele AI-implementatie betrokken geweest. De intranetredacteur merkt dat het bezoek aan zijn zorgvuldig bijgehouden pagina’s daalt: niet omdat de informatie slechter is geworden, maar omdat medewerkers Copilot vragen in plaats van het intranet raadplegen. Zijn werk wordt onzichtbaar, terwijl het wel zijn content is die stilletjes de basis vormt van de antwoorden die Copilot geeft.

Binnen het eigen team fragmenteert kennis over AI-tools net zo hard. De ene collega heeft Copilot grondig uitgeprobeerd, de andere mijdt het bewust, een derde gebruikt het intensief maar deelt niets. Er is geen gedeelde aanpak, geen collectief begrip van wanneer welk systeem te vertrouwen is. De afdeling die kennisfragmentatie zou moeten tegengaan heeft er zelf last van.

Voor de FG en security officer speelt dit anders maar niet minder urgent. Hun teams worden geacht toezicht te houden op verwerkingen en risico’s die ze niet kennen. Een DPIA (data protection impact assessment oftewel gegevensbeschermingseffectbeoordeling) uitvoeren op een AI-systeem dat al maanden operationeel is zonder dat iemand het meldde: het is een realistische situatie. De werklast groeit, de zichtbaarheid daalt.

De organisatie

Waar wordt AI-beleid gemaakt? In veel organisaties bij ICT, die Copilot uitrolt als IT-project, of bij HR, die een e-learning over AI samenstelt. Bij afdelingen die een RAG-systeem laten bouwen zonder te vragen wie de kennisbank beheert en of de inhoud op orde is. (RAG: retrieval augmented generation, een AI-model gekoppeld aan een eigen documentenbank, red.) Jij bent daar lang niet altijd bij. Niet bij de toolkeuze, niet bij de inrichting, niet bij de richtlijnen. En dat terwijl jij precies de vragen zou stellen die anderen niet stellen. Welke documenten mogen in dat RAG-systeem? Hoe borgen we dat alleen definitieve versies worden gebruikt? Welke verwerkingen vinden er plaats en zijn die gemeld? Wat zijn de beveiligingsrisico’s van deze configuratie?

Voor cluster 1 is dit een gemiste kans. Voor cluster 2 is het een structureel probleem. De FG heeft een wettelijke toezichtstaak die niet delegeerbaar is. De security officer draagt zware verantwoordelijkheden bij beveiligingsincidenten. Maar toezicht houden op implementaties waaraan je niet hebt meegedaan, op systemen die je niet kent, op datastromen die je niet ziet: dat is geen governance, dat is brandjes blussen achteraf.

DE VIER KERNRISICO’S

Artikel 20 schetste vier risico’s die de informatiehuishouding bedreigen. Alle vier spelen ze voor jou, elk op hun eigen manier. En onderzoeksbureau Gartner stelt dat 40 procent van de organisaties hierdoor stevige securityincidenten kunnen verwachten.

> Het kwaliteitsrisico zit in wat AI-systemen als bron gebruiken: verouderde documenten, concepten zonder statusaanduiding, ontbrekende metadata. AI maakt geen onderscheid en versterkt daarmee de ruis die al in de informatiehuishouding zit. Verouderde documenten in RAG-systemen vormen een overbekend probleem.

> Het transparantierisico zit in de onzichtbaarheid van het proces: welke documenten zijn geselecteerd, welke genegeerd, waarom dit antwoord en niet een ander. Dat is voor geen enkele gebruiker inzichtelijk, en dat maakt toezicht en verantwoording structureel moeilijk.

> Het fragmentatierisico zit in de individualisering van kenniswerk: wat in AI-conversaties wordt bedacht, afgewogen en geconcludeerd, blijft in die conversaties en keert niet terug naar het collectief.

> Het verantwoordingsrisico ten slotte zit in de onreconstrueerbaarheid van besluitvorming: als de onderbouwing van besluiten is verdwenen in AI-chats die niemand heeft bewaard, is achteraf verantwoording afleggen over die besluiten moeilijk of onmogelijk.

Voor jou zijn fragmentatie en transparantie het meest existentieel, en ze raken de twee clusters op tegengestelde manieren.

Fragmentatie: het collectieve geheugen lost op

Kennismanagement draait om één fundamentele opgave: zorgen dat wat een individu weet beschikbaar komt voor de organisatie. Dat is altijd al lastig geweest. Nu wordt het structureel ondermijnd.

Een medewerker spart een dagdeel met een AI-tool over een complex subsidieverzoek, werkt goede argumenten uit, weegt alternatieven af. De conclusie belandt in een memo. De redenering verdwijnt in een tijdelijke chat. Zijn collega begint volgende week aan een vergelijkbaar dossier en start van nul.

Dit is het patroon. Kennis die vroeger in een teamoverleg of lessons-learned-sessie belandde, verdwijnt nu in individuele AI-conversaties. De hele infrastructuur die je hebt opgebouwd om kennis te laten stromen – kennisbanken, communities of practice, best-practice-databases – wordt omzeild door een technologie die individueel gebruik eenvoudiger maakt dan ooit.

Transparantie: besturen wat je niet kunt zien

Voor de FG/DPO en de security officer is fragmentatie niet het kernprobleem. Zij worstelen met iets fundamentelers: onzichtbaarheid.

AI-systemen zijn geen transparante machines. Copilot doorzoekt SharePoint op basis van criteria die ook na onderzoek door de Rijksoverheid niet volledig transparant zijn gemaakt, maar vermoedelijk recentheid, gebruiksfrequentie en sociale nabijheid, niet beleidsstatus of geldigheid. Microsoft weigerde of kon niet volledig specificeren welke verwerkingen er precies door de verantwoordelijke regelneef Microsoft Graph plaatsvinden, welke documenten worden geselecteerd en op welke gronden. De doorsneegebruiker ziet en weet net als de overheid domweg niet welke documenten zijn meegewogen, welke zijn genegeerd en waarom.

Voor de kennismanager is dat vervelend. Voor de FG is het een wettelijk probleem. De AVG verplicht tot transparantie over gegevensverwerkingen. De AI Act verplicht tot het uitvoeren van impactbeoordelingen voor hoog-risico AI-toepassingen. Maar hoe voer je een DPIA uit op een systeem dat je niet kent, of op shadow AI-gebruik waarvan je het bestaan niet weet?

De security officer staat voor een vergelijkbare uitdaging. Data-uitstroom via prompts is geen hypothetisch risico. Het gebeurt, en het is grotendeels onzichtbaar, tenzij er actief op wordt gemonitord.

Het vervolg lees je in deel #2 op de volgende pagina. <

‘De problemen beginnen niet bij de technologie zelf, maar bij de manier waarop organisaties die invoeren’

‘In grote organisaties gebruikt een aanzienlijk deel van de medewerkers AI-tools die niet zijn goedgekeurd, verboden of niet’

‘De functioneel beheerder ontdekt op een maandagmorgen dat de Teams-omgeving die hij beheert ineens een nieuwe AI-functie heeft’

‘Het werk van de intranetredacteur wordt onzichtbaar, terwijl het wel zijn content is die de basis vormt van de antwoorden die Copilot geeft’

‘In veel organisaties wordt AI-beleid gemaakt bij ICT, die Copilot uitrolt als IT-project, of bij HR, die een e-learning over AI samenstelt’

‘Toezicht houden op datastromen die je niet ziet: dat is geen governance, dat is brandjes blussen achteraf’

‘Kennis die vroeger in een teamoverleg of lessons-learned-sessie belandde, verdwijnt nu in individuele AI-conversaties’

IP | vakblad voor informatieprofessionals | 03 / 2026

(23 #1)..|..(23 #2)

SIMON BEEN

AI IN HET INFORMATIEDOMEIN (23 #1)

Artikelenserie over kunstmatige intelligentie (23 #1)

Simon Been

Trainer en klankbord voor AI in het informatiedomein en directeur van het Papieren Tijger Netwerk

Wat is de impact van AI op het informatiedomein? Deze 23ste aflevering van de artikelenreeks richt zich op kennismanagers, intranetredacteuren, functioneel beheerders, privacy- en gegevensbeschermings-functionarissen en security officers. Zij bouwen en bewaken het informatiekundig fundament waarop het werk van de organisatie rust, en precies dat fundament staat onder druk. Dit deel #1 gaat over wat er gebeurt en waarom, het vervolg (deel #2) op de pagina hierna over wat jij eraan kunt doen.

Generatieve AI is een krachtig instrument. Dat is niet de discussie. Wie ermee werkt, merkt het: denken gaat sneller, overzicht komt gemakkelijker, communiceren wordt helderder. Geen wonder dat collega’s in de organisatie er gretig gebruik van maken; soms enthousiast, soms stilletjes. De technologie heeft absoluut beperkingen, maar levert doorgaans stevige voordelen.

De problemen beginnen zoals zo vaak niet bij de technologie zelf. Ze beginnen bij de manier waarop organisaties die invoeren. Zonder doordacht beleid. Zonder de juiste expertise aan tafel. Zonder oog voor wat er met de informatiehuishouding gebeurt als – soms duizenden – medewerkers AI-tools gaan gebruiken die niet zijn ingepast in de bestaande kennisstructuren. Als informatieprofessional herken je dit. Gelukkig kun je er ook iets aan doen. En dat is de missie achter deze reeks: verantwoord gebruik mogelijk te maken, op twee niveaus tegelijk.

> Op persoonlijk niveau gaat het om bewustwording: wie begrijpt hoe AI werkt en waar de keerzijden zitten, gebruikt het effectiever én vermijdt de valkuilen. Dat gaat niet om trucjes leren, maar om volwassen inzicht. Dat levert winst op voor de gebruiker zelf, en voor wat hij of zij produceert.

> Op organisatieniveau speelt hetzelfde, maar zijn er meer instrumenten. Persoonlijk verantwoord gebruik stimuleren is er één van. Wat deze artikelen belichten zijn informatiekundige randvoorwaarden en succesfactoren om AI in staat te stellen de belofte waar te maken. Niet als rem, maar als fundament.

Omdat ‘de’ informatieprofessional niet bestaat – de verantwoordelijkheid voor ‘informatie’ binnen organisaties is enorm versnipperd – onderscheiden we vier categorieën:

1. Organisatiegeheugen & Verantwoording

2. Informatieverstrekking & Ondersteuning

3. Kennisorganisatie & Informatiestromen

4. Communicatie & Externe Informatie

In de vorige IP’s is ingegaan op de situatie van de eerste twee categorieën informatieprofessionals en hun mogelijke reacties op de AI-impact. Voor archivarissen en DIV’ers (aflevering 21 deel #1 en deel #2 in deze reeks) verdampen de paper trails. Voor informatiespecialisten (artikel 22) worden gebruikers onzichtbaar zelfstandig. Voor de mensen die de kennisstructuren van de organisatie bouwen en bewaken is het probleem subtieler, en daardoor gevaarlijker.

KLASSIEKE KENNISSTROOM | AI-KENNISSTROOM |

Medewerker zoekt informatie | Medewerker vraagt AI |

Bron wordt expliciet geraadpleegd (intranet, kennisbank, document) | AI haalt informatie uit meerdere bronnen tegelijk |

Redactionele controle vooraf | Geen zicht op bronselectie |

Informatie blijft zichtbaar | Redenering verdwijnt |

Kennis wordt gedeeld via teams, wiki’s of overleg | Kennis blijft vaak |

EEN DIVERSE GROEP

De doelgroep van dit artikel is breder en diverser dan bij de vorige twee afleveringen. Het heeft zin even stil te staan bij wie er precies wordt aangesproken, want achter elke functietitel gaat een eigen wereld schuil. Enige verdieping vind je in het kader op de volgende pagina.

De kennismanager of contentmanager organiseert hoe kennis in de organisatie beschikbaar is en stroomt: als zelfstandige functie of gecombineerd met andere rollen, afhankelijk van de organisatie.

De intranetredacteur beheert interne informatiekanalen: van nieuws tot procedures tot beleidsinfo, als zelfstandige functie of gecombineerd met communicatie of secretariaat.

De functioneel beheerder is de schakel tussen gebruikers en ICT. Hij of zij beheert applicaties vanuit functioneel perspectief: bepalen wat een systeem moet kunnen, niet zozeer hoe het technisch werkt.

De privacy- en gegevensbeschermingsfunctionaris (FG of DPO) is de wettelijk verankerde toezichthouder op de verwerking van persoonsgegevens: onafhankelijk, met directe toegang tot de hoogste leiding.

De data en information security officer – in grotere organisaties de CISO – bewaakt de informatiebeveiliging: strategisch, operationeel of beide. De wettelijke verplichtingen zijn de afgelopen jaren fors uitgebreid.

Informatiehuishoudingspecialisten tenslotte raken aan meerdere van de categorieën in deze reeks. Wie primair bezig is met records, archivering en bewaarplicht, herkent zich meer in artikel 21.

TWEE CLUSTERS, ÉÉN GEDEELD PROBLEEM

Binnen deze groep zijn er twee clusters die elk op een eigen manier worden geraakt door AI. Het eerste cluster zijn de kennismanagers, intranetredacteuren en functioneel beheerders. Zij organiseren hoe kennis en informatie beschikbaar komen in de organisatie. Hun mandaat is functioneel: ze bestaan omdat de organisatie ze nodig heeft, niet omdat een wet ze verplicht. Hun gedeelde zorg is dat AI de structuren omzeilt die zij hebben opgebouwd en bovendien die structuren tegelijk als ‘voer’ gebruikt, zonder hun betrokkenheid.

Het tweede cluster zijn de privacy- en gegevensbeschermingsfunctionarissen en de security officers. Zij bewaken de regels rond informatie. Hun mandaat is wettelijk en groeit. Hun zorg is het omgekeerde: niet dat ze worden gepasseerd, maar dat ze hun wettelijke plicht niet meer kunnen waarmaken. Je kunt geen toezicht houden op wat je niet kunt zien.

Verschillende uitgangsposities, één gedeeld probleem: AI neemt hun grip op informatiestromen weg.

WAAR HET MISGAAT

De frontlinie: wat er dagelijks langs je heen gaat

Een beleidsmedewerker vraagt Copilot om de geldende aanbestedingsregels samen te vatten. Copilot antwoordt soepel en zeker, op basis van documenten in SharePoint. Wat de medewerker niet ziet: Copilot heeft ook een verouderd concept uit 2022 meegewogen, want dat document staat er nog steeds en heeft geen metadata die aangeven dat het niet geldig is. De intranetredacteur die het actuele beleid zorgvuldig heeft gepubliceerd weet van niets. De kennismanager die de kennisbank beheert ook niet. De medewerker vertrouwt het antwoord. Want het is intern en het klinkt compleet.

Dit speelt in elke organisatie waar AI is uitgerold in een documentomgeving die niet op orde is. En – laten we eerlijk zijn – die is zelden volledig op orde.

Tegelijk gebruikt een collega ChatGPT voor hetzelfde vraagstuk, maar dan via zijn privéaccount, met een intern beleidsdocument als context. De security officer heeft geen zicht op die datastroom. De FG/DPO ook niet. In grote organisaties gebruikt een aanzienlijk deel van de medewerkers AI-tools die niet zijn goedgekeurd. Verboden of niet. Volgens recent onderzoek is dat zelfs de helft.

En de functioneel beheerder? Die ontdekt op een maandagmorgen dat de Teams-omgeving die hij beheert een nieuwe AI-functie heeft. Voor samenvattingen bijvoorbeeld. Ingeschakeld door de leverancier, niet door hem. Geen projectplan, geen implementatiebesluit, geen betrokkenheid. Dat is het verschil met een formele systeemimplementatie, waarbij de functioneel beheerder normaal gesproken wel vroeg betrokken wordt. AI wordt niet als project uitgerold, maar als feature toegevoegd. Dat is een fundamenteel ander patroon.

De afdeling

Op afdelingsniveau stapelen de gevolgen zich op. De kennismanager krijgt vragen over AI-gebruik die hij niet goed kan beantwoorden, want hij is bij geen enkele AI-implementatie betrokken geweest. De intranetredacteur merkt dat het bezoek aan zijn zorgvuldig bijgehouden pagina’s daalt: niet omdat de informatie slechter is geworden, maar omdat medewerkers Copilot vragen in plaats van het intranet raadplegen. Zijn werk wordt onzichtbaar, terwijl het wel zijn content is die stilletjes de basis vormt van de antwoorden die Copilot geeft.

Binnen het eigen team fragmenteert kennis over AI-tools net zo hard. De ene collega heeft Copilot grondig uitgeprobeerd, de andere mijdt het bewust, een derde gebruikt het intensief maar deelt niets. Er is geen gedeelde aanpak, geen collectief begrip van wanneer welk systeem te vertrouwen is. De afdeling die kennisfragmentatie zou moeten tegengaan heeft er zelf last van.

Voor de FG en security officer speelt dit anders maar niet minder urgent. Hun teams worden geacht toezicht te houden op verwerkingen en risico’s die ze niet kennen. Een DPIA (data protection impact assessment oftewel gegevensbeschermingseffectbeoordeling) uitvoeren op een AI-systeem dat al maanden operationeel is zonder dat iemand het meldde: het is een realistische situatie. De werklast groeit, de zichtbaarheid daalt.

De organisatie

Waar wordt AI-beleid gemaakt? In veel organisaties bij ICT, die Copilot uitrolt als IT-project, of bij HR, die een e-learning over AI samenstelt. Bij afdelingen die een RAG-systeem laten bouwen zonder te vragen wie de kennisbank beheert en of de inhoud op orde is. (RAG: retrieval augmented generation, een AI-model gekoppeld aan een eigen documentenbank, red.) Jij bent daar lang niet altijd bij. Niet bij de toolkeuze, niet bij de inrichting, niet bij de richtlijnen. En dat terwijl jij precies de vragen zou stellen die anderen niet stellen. Welke documenten mogen in dat RAG-systeem? Hoe borgen we dat alleen definitieve versies worden gebruikt? Welke verwerkingen vinden er plaats en zijn die gemeld? Wat zijn de beveiligingsrisico’s van deze configuratie?

Voor cluster 1 is dit een gemiste kans. Voor cluster 2 is het een structureel probleem. De FG heeft een wettelijke toezichtstaak die niet delegeerbaar is. De security officer draagt zware verantwoordelijkheden bij beveiligingsincidenten. Maar toezicht houden op implementaties waaraan je niet hebt meegedaan, op systemen die je niet kent, op datastromen die je niet ziet: dat is geen governance, dat is brandjes blussen achteraf.

DE VIER KERNRISICO’S

Artikel 20 schetste vier risico’s die de informatiehuishouding bedreigen. Alle vier spelen ze voor jou, elk op hun eigen manier. En onderzoeksbureau Gartner stelt dat 40 procent van de organisaties hierdoor stevige securityincidenten kunnen verwachten.

> Het kwaliteitsrisico zit in wat AI-systemen als bron gebruiken: verouderde documenten, concepten zonder statusaanduiding, ontbrekende metadata. AI maakt geen onderscheid en versterkt daarmee de ruis die al in de informatiehuishouding zit. Verouderde documenten in RAG-systemen vormen een overbekend probleem.

> Het transparantierisico zit in de onzichtbaarheid van het proces: welke documenten zijn geselecteerd, welke genegeerd, waarom dit antwoord en niet een ander. Dat is voor geen enkele gebruiker inzichtelijk, en dat maakt toezicht en verantwoording structureel moeilijk.

> Het fragmentatierisico zit in de individualisering van kenniswerk: wat in AI-conversaties wordt bedacht, afgewogen en geconcludeerd, blijft in die conversaties en keert niet terug naar het collectief.

> Het verantwoordingsrisico ten slotte zit in de onreconstrueerbaarheid van besluitvorming: als de onderbouwing van besluiten is verdwenen in AI-chats die niemand heeft bewaard, is achteraf verantwoording afleggen over die besluiten moeilijk of onmogelijk.

Voor jou zijn fragmentatie en transparantie het meest existentieel, en ze raken de twee clusters op tegengestelde manieren.

Fragmentatie: het collectieve geheugen lost op

Kennismanagement draait om één fundamentele opgave: zorgen dat wat een individu weet beschikbaar komt voor de organisatie. Dat is altijd al lastig geweest. Nu wordt het structureel ondermijnd.

Een medewerker spart een dagdeel met een AI-tool over een complex subsidieverzoek, werkt goede argumenten uit, weegt alternatieven af. De conclusie belandt in een memo. De redenering verdwijnt in een tijdelijke chat. Zijn collega begint volgende week aan een vergelijkbaar dossier en start van nul.

Dit is het patroon. Kennis die vroeger in een teamoverleg of lessons-learned-sessie belandde, verdwijnt nu in individuele AI-conversaties. De hele infrastructuur die je hebt opgebouwd om kennis te laten stromen – kennisbanken, communities of practice, best-practice-databases – wordt omzeild door een technologie die individueel gebruik eenvoudiger maakt dan ooit.

Transparantie: besturen wat je niet kunt zien

Voor de FG/DPO en de security officer is fragmentatie niet het kernprobleem. Zij worstelen met iets fundamentelers: onzichtbaarheid.

AI-systemen zijn geen transparante machines. Copilot doorzoekt SharePoint op basis van criteria die ook na onderzoek door de Rijksoverheid niet volledig transparant zijn gemaakt, maar vermoedelijk recentheid, gebruiksfrequentie en sociale nabijheid, niet beleidsstatus of geldigheid. Microsoft weigerde of kon niet volledig specificeren welke verwerkingen er precies door de verantwoordelijke regelneef Microsoft Graph plaatsvinden, welke documenten worden geselecteerd en op welke gronden. De doorsneegebruiker ziet en weet net als de overheid domweg niet welke documenten zijn meegewogen, welke zijn genegeerd en waarom.

Voor de kennismanager is dat vervelend. Voor de FG is het een wettelijk probleem. De AVG verplicht tot transparantie over gegevensverwerkingen. De AI Act verplicht tot het uitvoeren van impactbeoordelingen voor hoog-risico AI-toepassingen. Maar hoe voer je een DPIA uit op een systeem dat je niet kent, of op shadow AI-gebruik waarvan je het bestaan niet weet?

De security officer staat voor een vergelijkbare uitdaging. Data-uitstroom via prompts is geen hypothetisch risico. Het gebeurt, en het is grotendeels onzichtbaar, tenzij er actief op wordt gemonitord.

Het vervolg lees je in deel #2 op de volgende pagina. <

IP | vakblad voor informatieprofessionals | 03 / 2026